728x90

AI 환각(hallucination)은 인공지능이 실제로 존재하지 않는 정보나 사실을 마치 진실인 것처럼 생성하는 현상입니다. 이 문제를 DIKW(Data, Information, Knowledge, Wisdom) 피라미드 관점에서 분석하고, AI 활용 최적화 방안입니다.

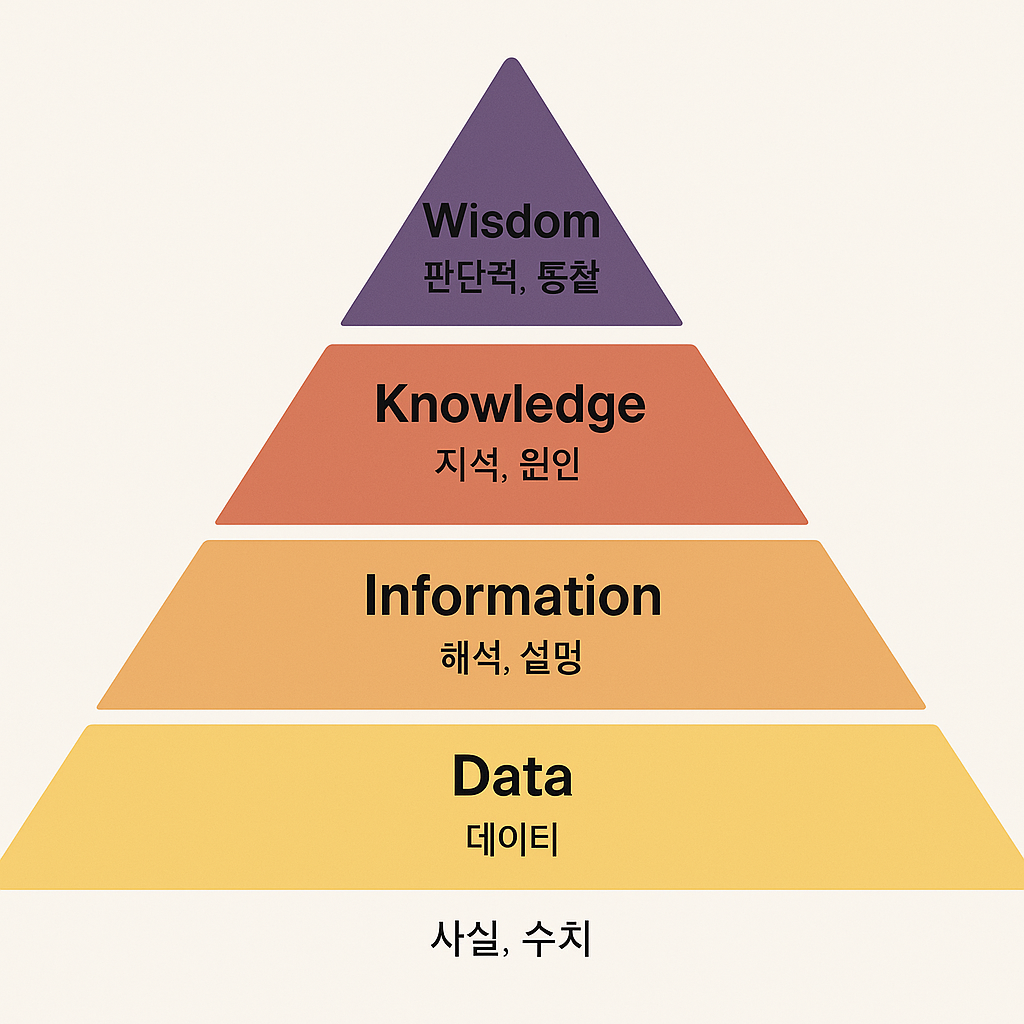

1. DIKW 피라미드와 AI 환각의 관계

DIKW 피라미드 개념

- Data(데이터): 가공되지 않은 원시적 사실/숫자 (예: "2025년 5월 16일")

- Information(정보): 데이터에 의미와 맥락을 부여한 것 (예: "서울은 대한민국에서 가장 인구가 많은 도시")

- Knowledge(지식): 정보 간 연관성과 패턴 이해 (예: "서울의 인구 밀도는 교통난과 주택 문제를 유발")

- Wisdom(지혜): 지식을 응용한 판단과 통찰 (예: "장기적 분산형 도시 정책 필요")

DIKW 피라미드와 AI 환각 발생 지점

┌──────────────┐

│ Wisdom │ ← 인간만 가능 (AI는 불가능)

│ 지혜 (판단력, 통찰) │

└────▲─────────┘

│ (환각 발생 위험: 낮음)

┌────┴─────────┐

│ Knowledge │ ← 의미 연결과 문맥 이해

│ 지식 (맥락, 원인-결과) │

└────▲─────────┘

│ (환각 발생 위험: 매우 높음)

┌────┴─────────┐

│ Information │ ← 사실을 문장으로 표현

│ 정보 (해석, 설명) │

└────▲─────────┘

│ (환각 발생 위험: 높음)

┌────┴─────────┐

│ Data │ ← AI가 학습한 원자료

│ 데이터 (사실, 수치) │

└──────────────┘

2. AI 환각 문제의 팩트, 견해, 추론 분석

팩트(Fact)

- AI 모델은 언어 데이터를 학습해 패턴을 생성하는 방식으로 작동

- AI는 정보의 정확성보다 "문법적 자연스러움과 패턴"을 더 잘 학습

- 환각은 AI가 존재하지 않는 정보를 사실처럼 제시하는 현상

- DIKW 구조에서 환각은 특히 정보(Information)와 지식(Knowledge) 수준에서 발생

견해(Opinion)

- AI는 데이터→정보 구성 과정에서 오류가 발생하며, 지식 단계로 넘어가면서 왜곡이 확대됨

- 인간은 문맥과 지속적 현실 기반 검증으로 지혜를 생성하지만, AI는 진위 여부 판단 능력 부재

- 가장 높은 환각 위험은 지식(Knowledge) 단계에서 발생함

추론(Inference)

- 환각은 주로 "data→information" 또는 "information→knowledge" 단계 전환에서 발생

- AI의 환각 발생 원인: "지속성(persistence)" 부재와 "사실 기반 검증(fact-checking)" 불가능성

- 해결책: AI 출력의 fact 기반 검증 메커니즘과 데이터 추적 가능성(traceability) 강화 필요

3. AI는 실제로 무엇을 "하는가"?

AI(특히 대규모 언어 모델)는 의미를 이해하거나 정보를 축적하지 않습니다.

| 단계 | 실제 AI가 하는 일 | 설명 |

|---|---|---|

| 1. 입력 수신 | 프롬프트(문장)를 입력받음 | 예: "마이클 패러데이는 누구야?" |

| 2. 패턴 인식 | 학습한 언어 데이터의 통계적 패턴을 기반으로 다음 단어 예측 | |

| 3. 출력 생성 | 예측한 단어들을 이어서 문장 생성 | "그는 영국의 과학자이며..." |

| 4. 의미 판단 X | AI는 의미/진위를 판단하지 않음 | 그럴듯해 보여도 틀릴 수 있음 |

| 5. 지속성 X | 앞서 했던 말이나 사실을 장기 기억하지 않음 | 지속된 맥락 유지에 한계 |

요약: AI는 지식을 쌓는 것이 아니라, 언어 패턴을 예측하여 생성하는 것입니다.

4. 구체 사례 분석: "마이클 패러데이는 전기를 발명했다"

팩트 vs 실제

- 실제 사실: 마이클 패러데이는 전기를 "발명"하지 않았음. 전기는 자연 현상이며, 그는 전자기 유도와 발전기 개념을 발견함

- AI 생성 문장: "마이클 패러데이는 전기를 발명한 사람이다"

환각 발생 과정

| DIKW 단계 | 과정 설명 |

|---|---|

| Data | "Faraday", "Electricity", "Electromagnetic induction" 등 키워드 학습 |

| Information | 키워드 조합으로 "Faraday와 전기 관련 있음" 문장 구성 |

| Knowledge | '관련 있음'을 넘어서 '창조했다'는 부정확한 인과 추론 생성 |

| Wisdom | 인간은 '전기를 발명했다'는 말이 물리적으로 틀렸음을 감지 가능. AI는 불가능 |

5. 환각 발생 원인 구조

| 원인 | 설명 | 예시 |

|---|---|---|

| 불완전한 학습 | 학습 데이터 부족/편향 | 특정 인물에 대한 잘못된 서술 |

| 문맥 왜곡 | 프롬프트가 모호하거나 추상적 | "그 사람 어때?" 같은 질문 |

| 지속성 부족 | 앞 문장과의 연결성 상실 | 앞에서 말한 내용을 부정함 |

| 확률 기반 예측 | 가장 가능성 높은 문장 생성, 진위는 모름 | "~을 발명했다"라는 잘못된 정보 |

6. AI 활용 최적화: 프롬프트 설계 전략

문제점: 일반적 서술형 프롬프트

❌ 예시: "패러데이에 대해 알려줘."

- 너무 추상적

- 정보와 견해가 혼합될 위험

- 환각 발생 가능성 높음

300x250

해결책: 규칙 기반 프롬프트 구성

👉 권장 구조

1. [사실(Fact)]와 [견해(Opinion)]를 구분해서 답변하라.

2. 정보는 출처 기반으로 생성하고, 가능한 한 수치/날짜 등 구체적으로 써라.

3. "~라고 알려져 있다"와 "실제로 증명된 바 있다"는 표현을 명확히 구분하라.

4. 정보가 불명확하거나 추론이 필요한 경우에는 [추론(Inference)]으로 따로 분리하라.

5. 출력 전에 사실 검토를 내부적으로 시행하고, 그렇지 못할 경우 '불확실함'을 명시하라.예시 프롬프트

"마이클 패러데이에 대해 다음 형식으로 요약하라.

- 팩트: []

- 견해: []

- 추론: []

가능하면 각 팩트에 출처나 연도 명시하고, 견해와 추론은 그 근거와 한계를 명시하라."

7. AI 활용 최적화 구조

| 항목 | 전략 |

|---|---|

| AI 이해 | AI는 지식 축적자가 아닌 언어 예측 모델 |

| 환각 예방 | 정보의 명확성, 출처 기반 표현 강조 |

| 프롬프트 | 구조화된, 규칙 기반 명령으로 명확하게 |

| 응답 양식 | 팩트/견해/추론 분리로 해석 가능성 최소화 |

| 지속성과 검증 | 장기 맥락은 제한적, 사용자가 직접 검증 필요 |

AI를 활용할 때는, 그것이 "지식을 가진 존재"가 아니라 "언어 생성 도구"라는 점을 인식하고, 명확한 질의 구조 + 응답 구분 체계(팩트/견해/추론)를 통해 환각 가능성을 줄이는 것이 가장 효과적인 방법입니다.

728x90

그리드형(광고전용)

댓글